Burgers accepteren steeds minder en dienen vaker een klacht in bij de Autoriteit Persoonsgegevens. Privacy moet een structureel onderdeel zijn van je organisatie. Als de basis ontbreekt dan blijf je achter de feiten aanlopen. De basis zet je neer door het inrichten van een privacy governance.

Lees verderSinds generatieve AI (genAI) beschikbaar is geworden voor een groot publiek, lijkt iedereen op zoek naar de beste manier om deze AI in te zetten. Hoe kan het ons werk makkelijker maken? Specifiek lijken AI Agents hier interessant in: autonome systemen die op basis van vooraf gedefinieerde doelen handelingen kunnen uitvoeren. Ook de privacywereld is in de ban geraakt van AI Agents: deze zouden kunnen helpen met DPIA’s (Data Protection Impact Assessments), die vaak als tijdrovend worden ervaren. Maar is dat ook zo?

Onze eerste ervaringen met AI Agents is dat deze inderdaad het uitvoeren van DPIA’s versnellen. Tegelijkertijd is het geen ei van Columbus: GenAI kan niet echt denkwerk vervangen dat nodig is om privacyrisico’s écht te begrijpen en te beheersen.

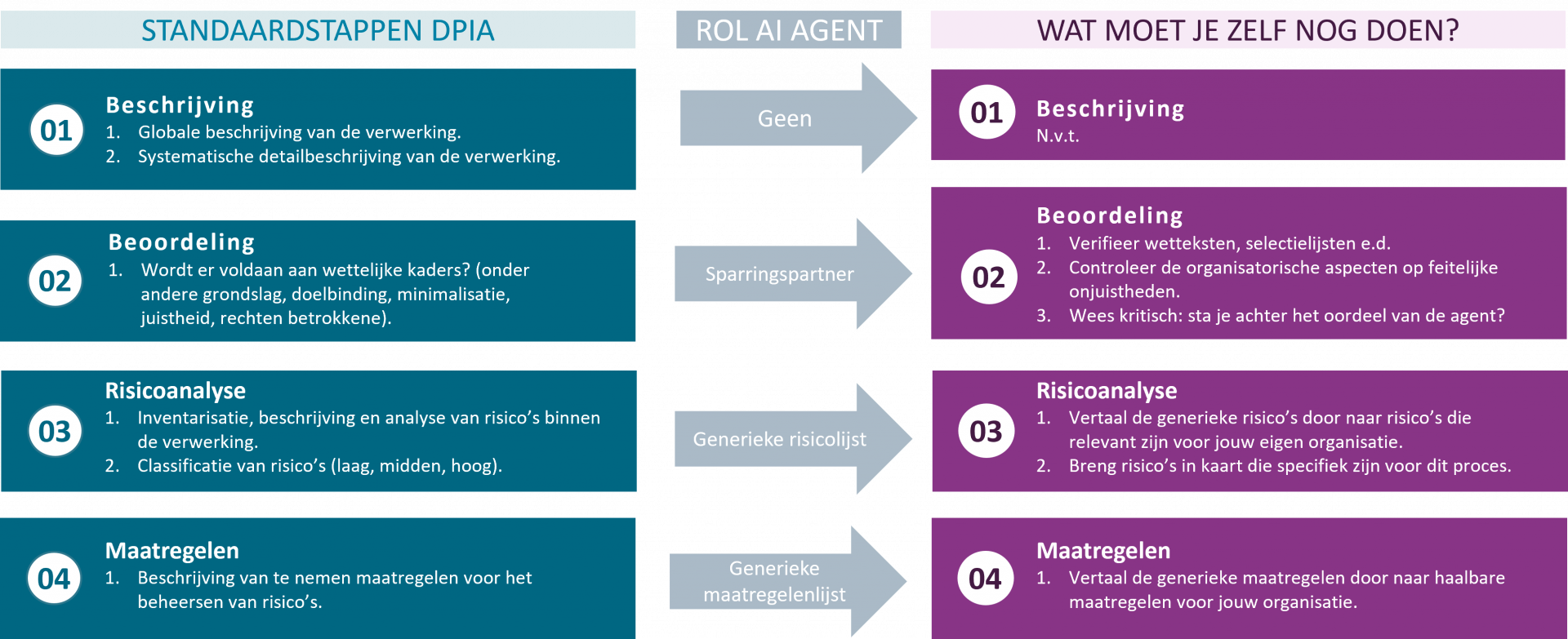

Elke DPIA bestaat uit vier onderdelen, die zijn beschreven in artikel 35 lid 7 van de AVG. Onze DPIA-methodiek is hier ook op gebaseerd. Zoals te zien is in de onderstaande afbeelding, kan een AI Agent ondersteunen met drie van de vier onderdelen van een DPIA, maar menselijke actie blijft noodzakelijk.

- De procesbeschrijving. Elke DPIA begint bij een heldere procesbeschrijving. Zonder een procesbeschrijving weet je immers niet waar je op moet toetsen. Een AI Agent kan veel, maar: het zal nooit ‘uit niets’ de processen van jouw organisatie kennen. Een AI Agent vragen om een procesbeschrijving van jouw processen is vragen om een abstract, algemeen en vaak onjuist verhaal.

- De beoordeling. Voor de stap: ‘beoordeling’ in de DPIA kan een AI Agent een goede assistent zijn. Het kan in een mum van tijd alle beschikbare wet- en regelgeving doorzoeken, waardoor er een goede juridische basis kan worden beschreven. Ook kan een AI Agent een conceptoordeel uitvoeren op de noodzakelijkheid van de verwerking (zoals dataminimalisatie, proportionaliteit en subsidiariteit). De kwaliteit en juistheid dienen wel te worden beoordeeld.

- Risico’s in kaart brengen. AI Agents kunnen lijsten met risico’s genereren, die je kunnen helpen om vast te stellen of deze risico’s van toepassing zijn voor jouw processen en jouw organisatie. Je kunt hier echter geen maatwerk verwachten. Het echte werk blijft dus mensenwerk: het vertalen van de generieke risico’s naar risico’s voor jouw organisatie.

- Maatregelen formuleren. Hetzelfde geldt voor mitigerende maatregelen. AI kan suggesties doen, maar die zijn vaak hoog-over en niet afgestemd op jouw organisatie. De vraag is niet alleen welke maatregel effectief is, maar ook of deze haalbaar is binnen jouw context. Dat vraagt om kennis van interne processen, budgetten, cultuur en politiek – allemaal zaken die AI niet kan overzien.

Een goed geconfigureerde AI Agent kan dus wel degelijk helpen met het uitvoeren van DPIA’s. Tegelijkertijd moeten we niet de bedoeling van DPIA’s uit het oog verliezen. Het doel van een DPIA is niet het produceren van een verslag, maar het beter beschermen van de privacy van betrokkenen. Ook zal AI niet helpen met het creëren van draagvlak onder betrokken medewerkers, terwijl dat wel noodzakelijk is voor het oppakken van de te nemen maatregelen. Zie de AI Agent dus als een goede assistent, niet als vervanger.

Terug naar het overzicht

Gerelateerde publicaties

Een meerderheid van de deelnemende ziekenhuizen (64%) is in meer of mindere mate bezig met experimenten en/of implementaties van AI. Dit blijkt uit het jaarlijks onderzoek van M&I/Partners naar de stand van AI bij Nederlandse ziekenhuizen uitgevoerd onder 53 vertegenwoordigers van 42 ziekenhuizen.

Lees verder